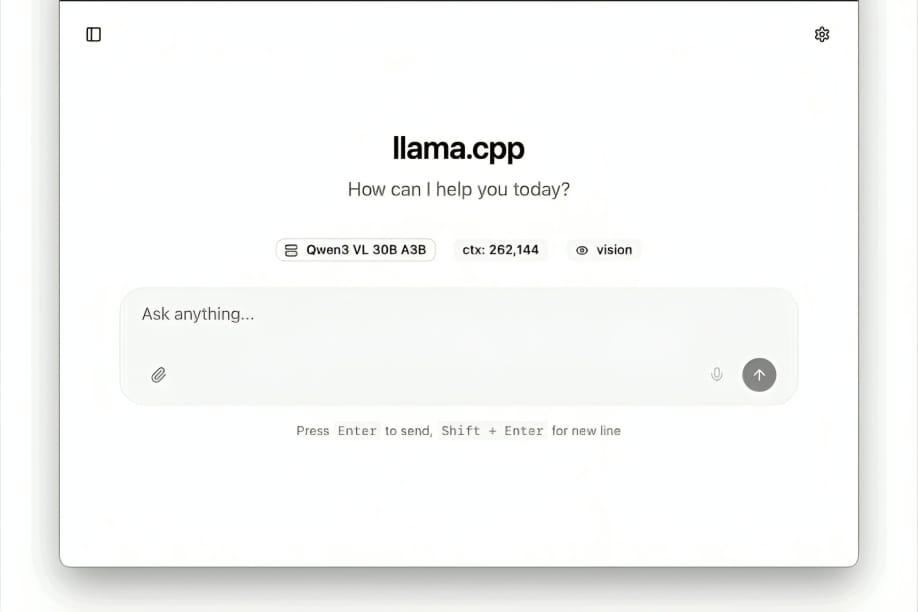

أصبح لدى llama.cpp واجهة: استخدم الذكاء الاصطناعي محلياً بخصوصية وتكاليف أقل

من الرائع أن نرى واجهة llama.cpp الجديدة، في تطبيق شبيه بـChatGPT يعمل بالكامل على حاسوبك المحمول، بدون إنترنت أو إرسال بيانات إلى أي خدمة خارجية، وهذه خطوة مهمة نحو الحوسبة المحلية الذكية، حيث الخصوصية والأداء هما الأولوية ؛؛

لمحة سريعة عن الإمكانيات ::

✴️ دعم أكثر من 150 ألف نموذج GGUF.

✴️ سحب وإفلات ملفات PDF أو صور أو مستندات نصية مباشرة.

✴️ إمكانية تعديل الفروع والمحادثات في أي وقت.

✴️ محادثات متوازية ومعالجة صور مدمجة.

✴️ عرض رياضيات ونتائج كود بوضوح.

✴️ توليد مقيد بدعم JSON schema للنتائج المهيكلة.

تجربة سريعة للتشغيل 👇

llama-server -hf ggml-org/gpt-oss-20b-GGUF –jinja -c 0

لماذا يهمك كمستخدم أو مؤسسة 🤔

لأن الحلول المحلية تُمكّن الشركات والمؤسسات البحثية من اختبار نماذج كبيرة بدون مخاطر تسريب البيانات أو فواتير API مرتفعة، هو ما يجعلها خياراً عملياً للبيئات الحساسة والإنتاج.

سوريا

سوريا

مصر

مصر

الإمارات

الإمارات

السعودية

السعودية

قطر

قطر